Z pewnością kojarzysz moje dwa wcześniejsze nagrania na temat detektorów AI. Mój przekaz w nich był jasny: detektory treści AI to jedno wielkie gówno. Po szczegóły odsyłam Cię do tych filmów – linki znajdziesz w opisie poniżej.

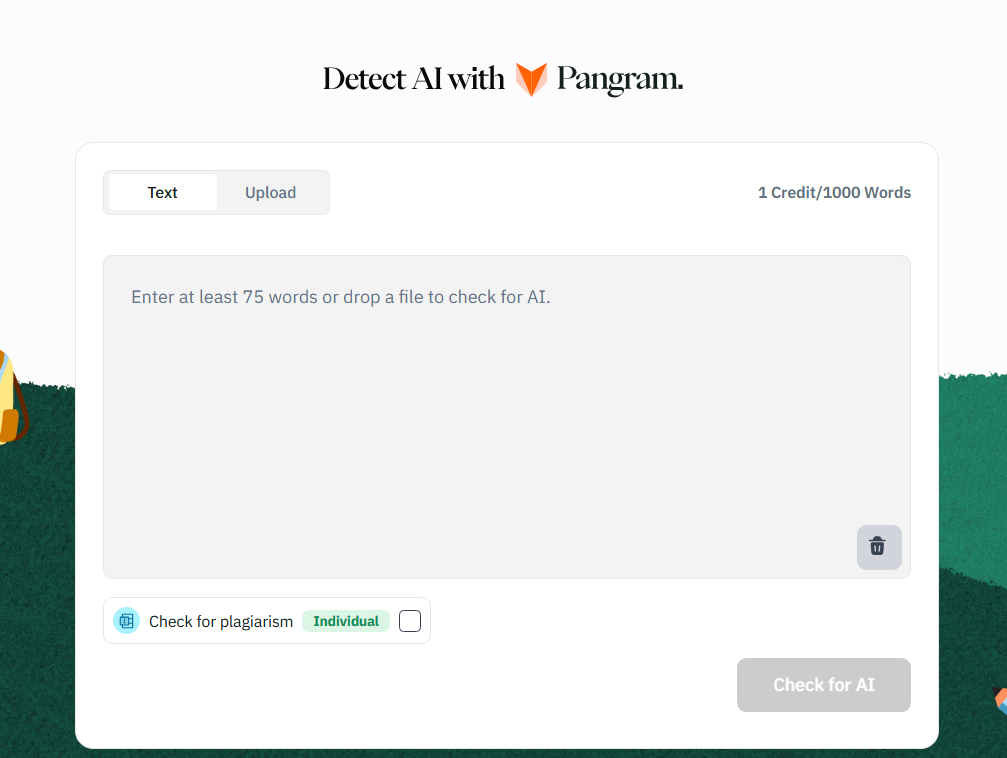

Dzisiaj chciałbym porozmawiać o moim nowym odkryciu sprzed ładnych paru miesięcy – detektorze treści Pangram. Jest to idealny przykład na to, jak szybko zmienia się świat AI i że nie ma sensu mieć zbyt definitywnych poglądów.

Pangram to detektor, który mnie naprawdę zaskoczył swoją skutecznością – w przeciwieństwie do na przykład Originality AI czy GPT Zero.

Co znajdziesz w tym artykule?

Kto stoi za Pangramem?

Pangram Labs to startup z Brooklynu założony przez Bradleya Ermi i Maxa Spero – dwóch naukowców regularnie publikujących na arXiv. To naukowe podejście bardzo mocno widać w działaniu Pangrama.

Jak działa Pangram?

Pangram działa zupełnie inaczej niż większość detektorów. Typowe narzędzia takie jak GPT Zero czy Originality badają przewidywalność tekstu, zmianę tonu i wyszukują charakterystycznych dla sztucznej inteligencji fraz i zwrotów. Tu pojawia się problem – dobrze wiesz, że obecne duże modele językowe są tak dobre, że na tej podstawie nie sposób oddzielić treści AI od ludzkich. O tym rozmawialiśmy w poprzednich nagraniach.

Dlatego GPT Zero i Originality kompletnie siadają na testach, osiągając od 50 do 70% wykrywalności – czyli de facto są zupełnie bezużyteczne. Tymczasem Pangram wyciąga na podobnych testach prawie 100%.

Dlaczego? Ponieważ Pangram używa całkowicie innego podejścia. Jest to klasyfikator oparty na dużych sieciach neuronowych, konkretnie na architekturze Mistral Nemo mającej 12 miliardów parametrów. Model jest wytrenowany nie do wykrywania przewidywalności tekstu, ale do rozpoznawania subtelnych wzorców stylistycznych – takich „mikrocisków” AI, których gołym okiem nie widać.

Technika lustrzanego tekstu

Firma Pangram, zamiast trenować model na losowych tekstach AI, zrobiła coś sprytnego. Dla każdego ludzkiego tekstu w zbiorze treningowym generują lustrzany tekst AI o tym samym temacie, długości i stylu.

Wyobraź sobie, że masz ludzką recenzję restauracji — napisaną przez człowieka. Pangram każe konkretnemu dużemu modelowi językowemu napisać recenzję tej samej restauracji o identycznych parametrach: taka sama długość, taka sama liczba gwiazdek, te same elementy, które się podobały lub nie. Dzięki temu model nie może iść na skróty – musi faktycznie wyłapać różnicę w samym sposobie pisania.

Hard negative mining

Druga technika to tak zwany hard negative mining. Działa to tak: Pangram trenuje początkowy model, a potem puszcza go na milionach ludzkich tekstów. Zbiera wszystkie „wpadki”, czyli teksty ludzkie, które model błędnie oznaczył jako napisane przez AI. Te trudne przypadki wracają do zbioru treningowego i model trenuje się od nowa. Efekt? Z każdą rundą coraz mniej fałszywych oskarżeń.

Skuteczność Pangrama

Jaką skuteczność ma Pangram? Dużą – tak jak powiedziałem, prawie 100%. Myli się raz na 500 przypadków. Mówiąc inaczej: jedna na 500 prac jest nieprawidłowo oceniona. GPT Zero dla przykładu oznacza błędnie jedną na 11 prac.

Czym są humanizatory i czy da się oszukać Pangrama?

Wiemy już, jak działa Pangram. Pewnie zastanawiasz się, czy da się go oszukać. Zanim przejdziemy do testu, odpowiedzmy sobie na jedno pytanie: czym są humanizatory?

Humanizatory to narzędzia, do których wrzucasz tekst wygenerowany przez AI, a one go przerabiają tak, żeby detektory nie wykryły sztucznej inteligencji.

Jak działają? Na różne sposoby. Te gorsze po prostu zamieniają słowa na synonimy. Inne dodają losowe, bezsensowne frazy do tekstu, licząc na to, że detektor pomyśli: „sztuczna inteligencja by tak głupio nie napisała, więc to pewnie człowiek”. Rozumiecie – takie celowe psucie tekstu.

Ale są też humanizatory wyższej klasy. To de facto osobne modele językowe wytrenowane specjalnie pod parafrazowanie tekstu AI tak, żeby brzmiał naturalnie. Te są o wiele trudniejsze do wykrycia, bo tekst po obróbce jest nadal płynny i czytelny.

Paradoks humanizatorów

Pangram przetestował 19 różnych humanizatorów i podzielił je na trzy poziomy jakości. I tutaj wychodzi pewien paradoks: im lepszy humanizator (im bardziej płynny tekst produkuje), tym łatwiej Pangram go wykrywa. A te najgorsze, produkujące bełkot i śmieci? Te się czasem wymykają – ale za to każdy człowiek od razu zobaczy, że coś jest nie tak z tekstem.

Test w praktyce

Przygotowałem test. W ChatGPT (model GPT-5.2 w trybie myślenia) wygenerowałem artykuł blogowy za pomocą prostego promptu. Następnie przepuściłem go przez dwa płatne humanizatory — specjalnie je wykupiłem na potrzeby tego testu.

Wyniki? Pangram tekst prosto z ChatGPT oznaczył jako 100% AI – żadne zaskoczenie. Tekst z pierwszego humanizatora (Stealth GPT) – również 100% AI. Czyli tego humanizatora można sobie podarować.

Przetestowałem też GPT-sy reklamujące się jako humanizatory (w tym mojego własnego, którego kiedyś stworzyłem do testów). Po drobnych ręcznych ingerencjach w tekst – zamianie półpauz na przecinki, dodaniu celowych literówek – Pangram dalej wskazywał 100% AI.

Usunięcie drobnych szczegółów, dodanie literówki, celowe zepsucie tekstu – nic nie pomogło. Pangrama nie udało się oszukać.

Podsumowanie: czy wierzyć detektorom treści AI?

Nie liczy się to, czego użyłeś do napisania tekstu. Liczy się jego jakość. Naprawdę nie ma żadnego znaczenia, czy tekst stworzyłeś po staremu w Wordzie, na maszynie, a może napisałeś wiecznym piórem. Jeżeli tekst jest gówniany, to Ci to nie pomoże.

Oczywiście jest temat edukacji – być może czytają to nauczyciele i tutaj sytuacja wygląda trochę inaczej. Na edukacji się nie znam, nie chcę się wypowiadać. Znam się na marketingu internetowym i tutaj jestem w stanie podpisać się pod tym, co powiedziałem: nie ma znaczenia narzędzie, które wykorzystałeś do tworzenia treści – liczy się jakość.

Czym jest jakość? Czy dany tekst odpowiada na intencje użytkownika? Czy jest merytoryczny? Czy nie jest bełkotem, chlaniem wody, upychaniem fraz kluczowych na siłę?

Co do samego Pangrama? Jest to bardzo dobry detektor. Daje radę i ciężko go oszukać. Dajcie znać w komentarzach, czy Wam się udało go przechytrzyć!